Aufwändige Recherche zum Diebstahl von Kinderfotos

Panorama suchte mit spezieller Software auf sogenannten Kinderpornografie-Plattformen nach Fotos, die bei Facebook oder Instagram geklaut wurden - und fand Hunderttausende Bilder. Es ist das erste Mal, dass die Dimension des Bilderdiebstahls deutlich wird. Auch deutsche Kinder und Eltern sind massenhaft betroffen.

***TRIGGER-WARNUNG***

Im Beitrag werden sexualisierte Gewalthandlungen geschildert. Diese können belastend sein.

Es ist immer wieder derselbe Junge, noch keine zehn Jahre alt. Beim Fußballtraining, beim Shopping, im Schwimmbad. Harmlose Bilder, Schnappschüsse. Ein ganzes virtuelles Fotoalbum, mit 979 Fotos und 105 Videos. Entdeckt in einem Forum im sogenannten Darknet, in dem Darstellungen von schwerem Kindesmissbrauch geteilt werden. Die Aufnahmen stammen allesamt von der Instagram-Seite des Jungen aus Süddeutschland. Die ist offenbar eine Art Selbstbedienungsladen für Pädosexuelle geworden. Für die Eltern ein Schock. Sie fühlen sich hilflos - und löschen die Instagram-Seite des Sohnes.

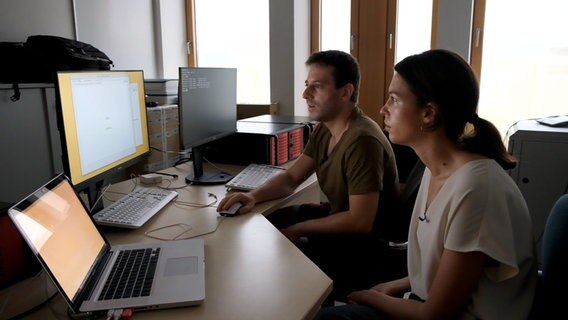

Viele Eltern und Jugendliche können sich nicht vorstellen, dass so etwas mit ihren Fotos passiert - denn sie bekommen meist überhaupt nicht mit, wenn irgendwer ihre Fotos anderswo veröffentlicht. Erst recht nicht, wenn Pädosexuelle die Bilder aus den Social Media-Profilen kopieren und sie auf Plattformen zum Tausch von Missbrauchsdarstellungen hochladen. Meist nennen die Täter zu den Fotos den Namen und das Alter der Kinder und erstellen ganze Collagen, die von den Usern dann durch Kommentare in einen sexuellen Kontext gerückt werden. Einmal geklaut, bleiben die Fotos meist für immer im Internet. Ein Rechercheteam von Panorama und STRG_F wollte wissen, wie groß das Problem ist und startete ein mehrmonatiges Datenprojekt, in dem Millionen von Fotos auf ihre Herkunft analysiert wurden. Gemeinsam mit einem Informatiker und Darknet-Experten entwickelte die Redaktion unter hohen Sicherheitsvorkehrungen und mit rechtlicher Beratung ein Verfahren, mit dem Fotos identifiziert werden können, die ursprünglich bei Facebook und Instagram gepostet wurden, ehe sie von Pädosexuellen geklaut und in den Foren wieder hochgeladen wurden.

Auf der Spur der geklauten Fotos

Wo aber fängt die Suche nach den gestohlenen Fotos an? Die Online-Welt der Pädosexuellen sieht komplett anders aus als das Internet, wie man es für gewöhnlich kennt. Es gibt keine zentrale Suchmaschine wie Google, kein einzelnes großes Netzwerk wie Facebook und auch keinen zentralen Messenger wie WhatsApp. Stattdessen pflegt die "Community", wie sich selbst nennt, Listen mit Links zu Portalen und Diensten, die für den Erwerb und Austausch von sogenannter Kinderpornografie nützlich sind. Einige davon führen ins anonyme sogenannte Darknet, doch viele liegen auch im gewöhnlichen Internet.

Die Alltagsfotos von Kindern bezeichnen die Pädosexuellen als "Non Nude", also "nicht nackt". Schnell wird klar: Überall dort, wo Darstellungen von Kindesmissbrauch getauscht werden, interessieren sich die Nutzer auch für "Non Nude"-Inhalte - und das allermeiste davon ist offensichtlich aus dem Internet von Profilen gestohlen. Es gibt für "Non Nude" eigene Kategorien in diesen einschlägigen Foren, in denen zwei Klicks entfernt auch Aufnahmen von Kindesmissbrauch ausgetauscht werden, genannt "Hardcore". Es gibt auch Foto-Plattformen, auf denen überwiegend "Non Nude"-Inhalte getauscht werden, teilweise sind dort mehrere Millionen Kinderfotos zu sehen - jeweils mit Namen und Alter der Kinder.

Facebook und Instagram "verraten" sich durch die Metadaten

Bisher ist nie untersucht worden, wie viele dieser Alltagsbilder von Social Media geklaut wurden. Für Facebook und Instagram, welches zum Facebook-Konzern gehört, fand das Panorama-Team nun erstmals einen Ansatz, die Herkunft der Bilder auf den Plattformen der Pädosexuellen zu klären. Facebook schreibt nämlich in jedes Foto einen kleinen "Facebook-Code" in die sogenannten Metadaten. Lädt beispielweise ein Jugendlicher bei Instagram ein Foto hoch, schreibt die Plattform in die Metadaten neben den Angaben wie Datum, Größe, Dateiformat auch den Hinweis, dass das Foto schon einmal bei Instagram hochgeladen wurde.

Dieser "Facebook-Code" bleibt bestehen, wenn Pädosexuelle die Fotos klauen und unverändert irgendwo anders hochladen. Panorama lud daher von den Pädosexuellen-Plattformen die "Non Nude"-Inhalte runter, sofern dies rechtlich zulässig war, und suchte anschließend in den Metadaten der Bilder nach dem "Facebook-Code".

Auch Hinweise auf WhatsApp, TikTok und FlickR

Besonders häufig entdeckte das Recherche-Team diesen "Facebook-Code" auf der Fotoplattform "Cutie Garden", die sowohl im Darknet als auch über das gewöhnliche Internet erreichbar ist - und gerne von Pädosexuellen genutzt wird. Auf diesem sogenannten Imageboard können User anonym Fotos von Kindern posten und kommentieren. In 142.381 Fotos tauchte zum Zeitpunkt der Analyse bei rund 23,5 Prozent der "Facebook-Code" wieder auf. Etwa jedes vierte Foto wurde also unverändert von Facebook- und Instagram-Profilen bei "Cutie Garden" hochgeladen. Die Dunkelziffer dürfte noch höher liegen, weil manche User den "Facebook-Code" in den Metadaten löschen. Außerdem fand Panorama eindeutige Hinweise, dass Fotos auch von Diensten wie WhatsApp, Tiktok, Pinterest und Flickr geklaut wurden.

Geklaute Bilder tauchen auf mehreren Plattformen auf

Die größte Plattform für Alltagsfotos von Kindern kommt dem ersten Anschein nach unschuldig daher. Wer "imgsrc.ru" aufruft, sieht auf der Startseite meist imposante Landschaftsbilder. Das größte Interesse zieht jedoch die Kategorie "Kids" auf sich. Bis zum Ende der Analysen wurden die rund drei Millionen Kinderfotos, die unter "Kids" gespeichert sind, über 14 Milliarden Mal angeklickt. Auf "Kids"-Bilder haben die User damit häufiger geklickt als auf alle anderen Fotos zusammen.

Panorama lud sowohl Fotos von "Cutie Garden" als auch eine Stichprobe von "imgsrc.ru" herunter und verglich sie mittels spezieller Algorithmen auf Ähnlichkeiten. Ergebnis: 10.456 Fotos waren identisch, tauchten also auf beiden Plattformen auf. Dies dürfte daran liegen, dass Pädosexuelle die Bilder an mehreren Orten hochladen, wenn sie Bilder geklaut haben. Für Opfer ist dies besonders problematisch, denn selbst wenn auf einer Plattform ihre Bilder gelöscht werden sollten, sind sie an anderen Orten weiterhin verfügbar. Das Internet vergisst nichts.

Auf Klassenfotos werden die "heißesten Kids" gesucht

Die Pädosexuellen interessieren sich für alle Formen von Alltagsfotos, auf denen Kinder zu sehen sind. Besonders beliebt sind zwar Fotos, in denen Kinder beispielsweise in Badehose am Strand stehen, der Rock "unglücklich verrutscht" ist oder die Kinder Sportfiguren machen wie einen Spagat beim Turnen. Vielfach teilen die User aber auch gewöhnliche Porträts von Kindern, Selfies oder Alltagsszenen wie das Eis-Essen mit der Familie. Auch Gruppenbilder sind beliebt. Panorama identifizierte einige Schulen, deren "offizielle" Klassenfotos geklaut und hochgeladen wurden. Die User bewerten die Gruppenfotos anschließend danach, welche Kinder sie am hässlichsten finden und welche sie am liebsten sexuell missbrauchen würden.

In einem unter falscher Identität geführten Chat bestätigte ein deutschsprachiger User, dass er sich bei Facebook, Instagram und Flickr bediene. Er teilt selbst viele Bilder und nennt sich "Traderer", also etwa "Händler". Ein schlechtes Gewissen habe er nicht. "Ach, die haben doch nichts dagegen. Sie haben die Bilder ja offen gemacht." Tatsächlich sehen sich auch in den Foren für sogenannter Kinderpornografie viele Nutzer moralisch im Recht, Fotos zu klauen, wenn sie von Eltern und Jugendlichen ins Netz gestellt wurden.

Ermittlungsbehörden haben andere Prioritäten

Strafermittlern ist das Problem mit den Alltagsfotos bekannt, doch sie werden eigentlich nie aktiv. "Wir stellen immer wieder fest, dass sich auch Alltagsbilder von Kindern auf den Asservaten befinden, die wir bei Durchsuchungen sicherstellen", sagt Julia Bussweiler von der Generalstaatsanwaltschaft Frankfurt. In der dortigen Zentralstelle für die Bekämpfung von Internetkriminalität hat sich Bussweiler auf Ermittlungen gegen Pädosexuelle spezialisiert. "Man muss sich vor Augen führen, dass Kinderpornografie mittlerweile ein Massenphänomen ist. Wir haben alle Hände voll zu tun, diesen Hinweisen nachzugehen. Die Alltagsbilder spielen deshalb nur eine untergeordnete Rolle", sagt Bussweiler.

Gerade wenn die Fotos an sich gar nicht strafbar sind, dürfen Strafermittler selbst gar nicht tätig werden. Die Betroffenen müssten erst eine Anzeige erstatten - aber da Eltern und Kinder nicht wissen, dass ihre Fotos irgendwo zirkulieren, kommt es praktisch nie zu solchen Anzeigen. Auch die sozialen Netzwerke schieben die Verantwortung von sich. YouTube und Facebook betonen auf Anfrage von Panorama, viel für den Schutz von Kindern auf ihren Plattformen zu tun, beispielsweise durch den Einsatz intelligenter Algorithmen, Content-Moderatoren und Privatsphäre-Einstellungen für die User.

Täter wiegen sich in Sicherheit

Dass Ermittlungsbehörden praktisch nie tätig werden und Opfer ihnen nicht auf die Schliche kommen, wissen die Täter genau. Viele deutschsprachige User wiegen sich so sehr in Sicherheit, dass sie bei "imgsrc.ru" öffentlich deutsche Email-Adressen angeben. In manchen Kommentaren fragten User auch offen, wer die Namen der Kinder kenne und ob ein persönliches Treffen möglich sei. Doch trotz solch offener Spuren konzentrieren sich die Ermittlungsbehörden auf andere Fälle, um sogenannte Kinderpornografie aus dem Netz zu nehmen und die Täter zu ermitteln. Staatsanwältin Bussweiler appelliert bei den Alltagsbildern eher an die Vernunft der Eltern und Jugendlichen: "Man muss sich immer die Kontrollfrage stellen: Will ich damit leben, dass solche Bilder möglicherweise durch andere Personen missbraucht werden? Wenn man diese Frage mit 'Nein' beantwortet, dann sollte man das Foto einfach nicht öffentlich machen."

Die monatelangen und aufwändigen Recherchen begannen bereits vor der Corona-Pandemie. Dies erklärt, warum die Autor*innen bisweilen keine Masken tragen.